مراجعة أساليب تعلم الآلة ذات الصلة

في هذا القسم سنراجع بعض المصطلحات والأساليب الرئيسية من تعلم الآلة الكلاسيكي التي ستساعدنا على فهم سير العمل في تعلم الآلة الكمومي بصورة أفضل. سنبدأ بتقديم بعض المصطلحات العامة، ثم نتعمق في نوعَين من تعلم الآلة: أساليب النواة (خاصةً في سياق آلة المتجهات الداعمة) والشبكات العصبية. توجد بالتأكيد صلات بين هذه الأساليب، لكننا سنتعامل معها كأساليب متمايزة نظرًا للفوارق في سير العمل الكمومي المناقشة هنا وفي دروس لاحقة. هذه مجرد نظرة عامة سريعة، وسنتخطى قدرًا كبيرًا من الدقة التفصيلية. للاطلاع على نظرة عامة أكثر اكتمالًا لتعلم الآلة، نوصي بمصادر كـ[1-3].

أنواع تعلم الآلة

كتعريف بسيط، تعلم الآلة هو مجموعة من الخوارزميات التي تُحلّل البيانات وتستخلص منها استنتاجات بناءً على الأنماط والعلاقات فيها. بشكل عام، يمكن تصنيف خوارزميات تعلم الآلة في ثلاث فئات رئيسية وفق نوع البيانات المستخدمة وكيفية تعلم الخوارزميات دون برمجة صريحة:

- التعلم بإشراف: في التعلم بإشراف، البيانات المستخدمة لتدريب النموذج مُوسومة. هدف هذه الخوارزميات هو تعلّم العلاقة بين البيانات وتسمياتها أو مخرجاتها المقابلة والتعميم على البيانات غير المرئية. المهام الشائعة في هذه الفئة هي التصنيف والانحدار.

- التعلم دون إشراف: في مقابل التعلم بإشراف، يستخدم التعلم دون إشراف بيانات غير مُوسومة لتدريب نموذج تعلم الآلة. هدف هذه الخوارزميات هو اكتشاف الأنماط والهياكل الخفية في البيانات. بعض الخوارزميات في هذه الفئة هي خوارزميات التجميع (clustering) والتقليل من الأبعاد. يمكن اعتبار بعض النماذج التوليدية مثل الشبكات التوليدية التنافسية والمشفرات الذاتية المتغيرة (variational autoencoders) ضمن هذه الفئة أيضًا.

- التعلم بالتعزيز: خوارزميات هذه الفئة مُعرَّفة بعميل يتفاعل مع بيئة. يتخذ العميل إجراءات ويتلقى تغذية راجعة من بيئته على شكل مكافآت وعقوبات. من خلال آلية التغذية الراجعة هذه في نهاية المطاف، يتعلم العميل اتخاذ مجموعة الإجراءات الصحيحة لأداء مهمة محددة.

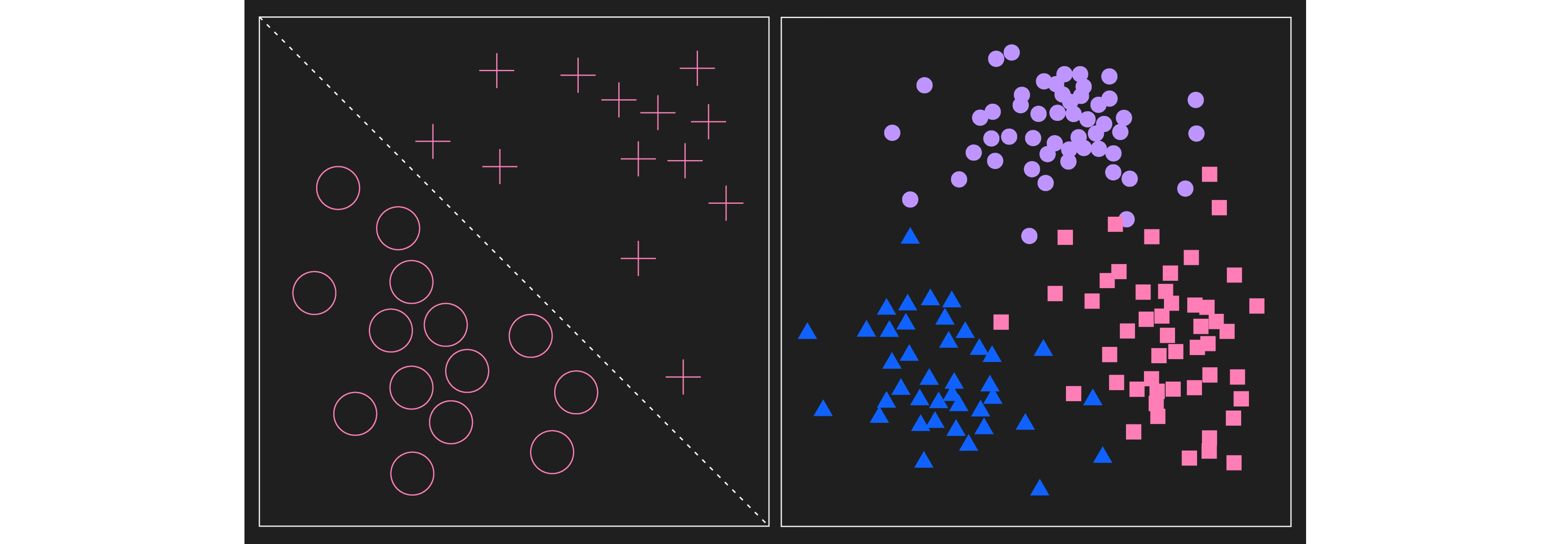

تُظهر الصورة على اليسار فئتَين من البيانات الموسومة كما في التعلم بإشراف. في هذه الحالة، الفئتان قابلتان للفصل خطيًا. تُظهر الصورة على اليمين تجمعات من البيانات. في مهمة التعلم دون إشراف، لن تكون هذه البيانات موسومة في البداية وستدرس الخوارزمية التوزيع ربما بحثًا عن التجمعات. لأغراض تصوير التجمعات التي قد تُحددها الخوارزمية بشكل مرئي، تم وسم نقاط البيانات الآن. الفارق الرئيسي بين الاثنين هو أن عملية التعلم بإشراف تبدأ بالبيانات موسومة بالفعل بينما تبدأ عملية التعلم دون إشراف ببيانات غير موسومة، حتى لو وُسمت البيانات في النهاية.

إدخال "الكم" في تعلم الآلة

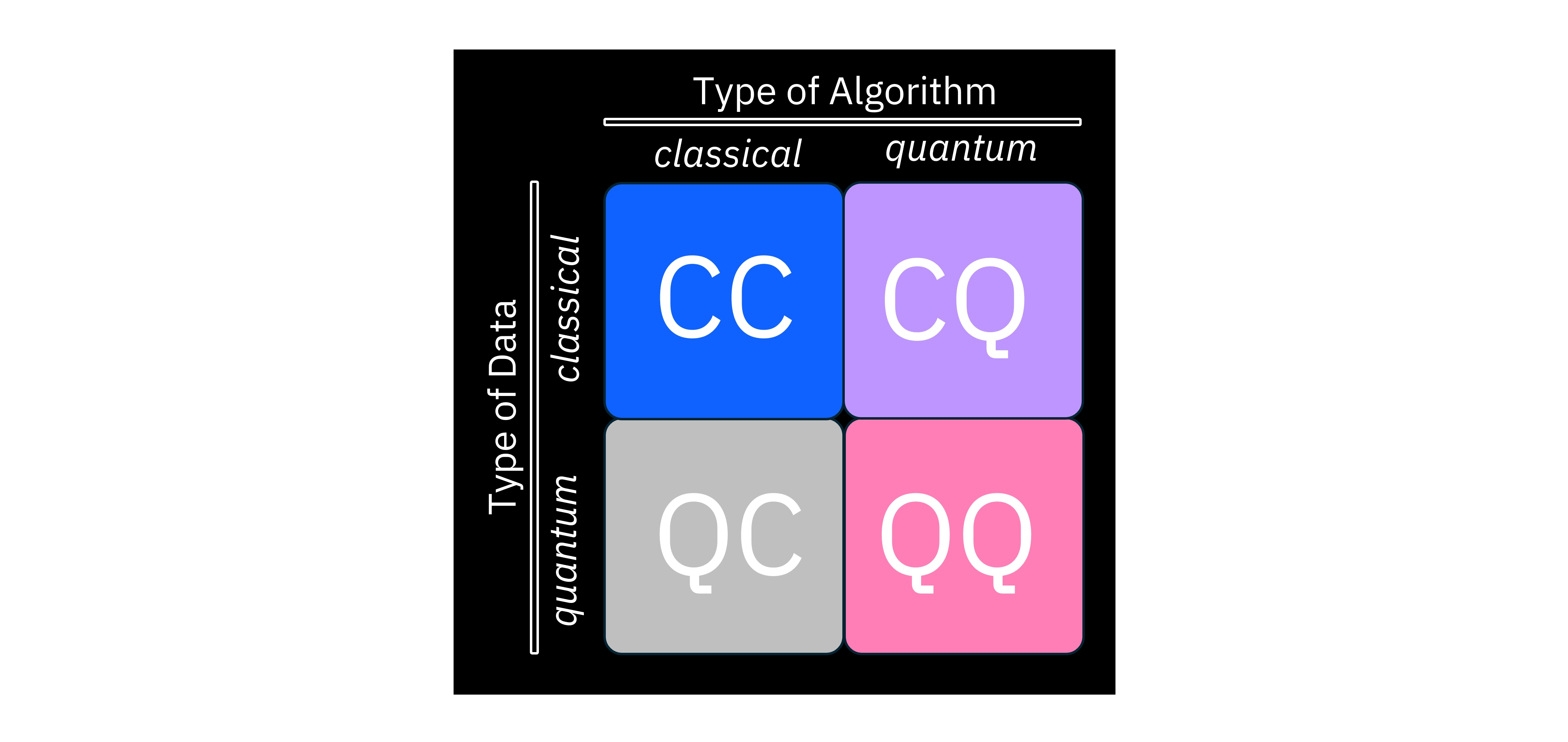

يمكننا الآن البدء في استكشاف كيفية إدخال "الكم" في تعلم الآلة. في هذا التصنيف الأشمل، نأخذ بعين الاعتبار نوع النموذج/الخوارزمية على جهاز المعالجة، إضافةً إلى نوع البيانات المقدَّمة إليه. الصورة أعلاه تُلخّص هذه التوليفات الممكنة.

على سبيل المثال، CC يعني أن لدينا مجموعة بيانات كلاسيكية — كالصور والصوت والنصوص التي يمكن تخزينها على الحواسيب الكلاسيكية — وأننا نستخدم أيضًا حاسوبًا كلاسيكيًا لتشغيل خوارزمية تعلم الآلة. هذا بالضبط إطار تعلم الآلة الكلاسيكي. من ناحية أخرى، QQ يعني أننا نستخدم حاسوبًا كموميًا لمعالجة بيانات كمومية. "البيانات الكمومية" هنا قد تعني أشياء عدة وقد تكون سياقية. يمكن التفكير في البيانات الكمومية كمجموعة من نتائج القياسات المأخوذة من جهاز كمومي، أو قد تشير إلى حالات جُهِّزت على حاسوب كمومي بخوارزمية أخرى. في المستقبل، قد تشير حتى إلى بيانات مخزنة في QRAM (ذاكرة وصول عشوائي كمومية)، التي لا توجد حاليًا. حين يتحدث الباحثون عن تعلم الآلة الكمومي، يشيرون عادةً إلى نظام CQ، حيث مجموعة البيانات المتاحة كلاسيكية وجهاز المعالجة المنفِّذ لخوارزمية تعلم الآلة هو حاسوب كمومي. في الأجزاء التالية من الدورة، سنركز على مثل هذه الخوارزميات.

آلات المتجهات الداعمة

نستعرض الآن فئة من الخوارزميات تُسمى آلات المتجهات الداعمة من منظور تعلم الآلة الكلاسيكي. لاحقًا سنُظهر كيف يمكن إدخال الحوسبة الكمومية في هذه الخوارزمية.

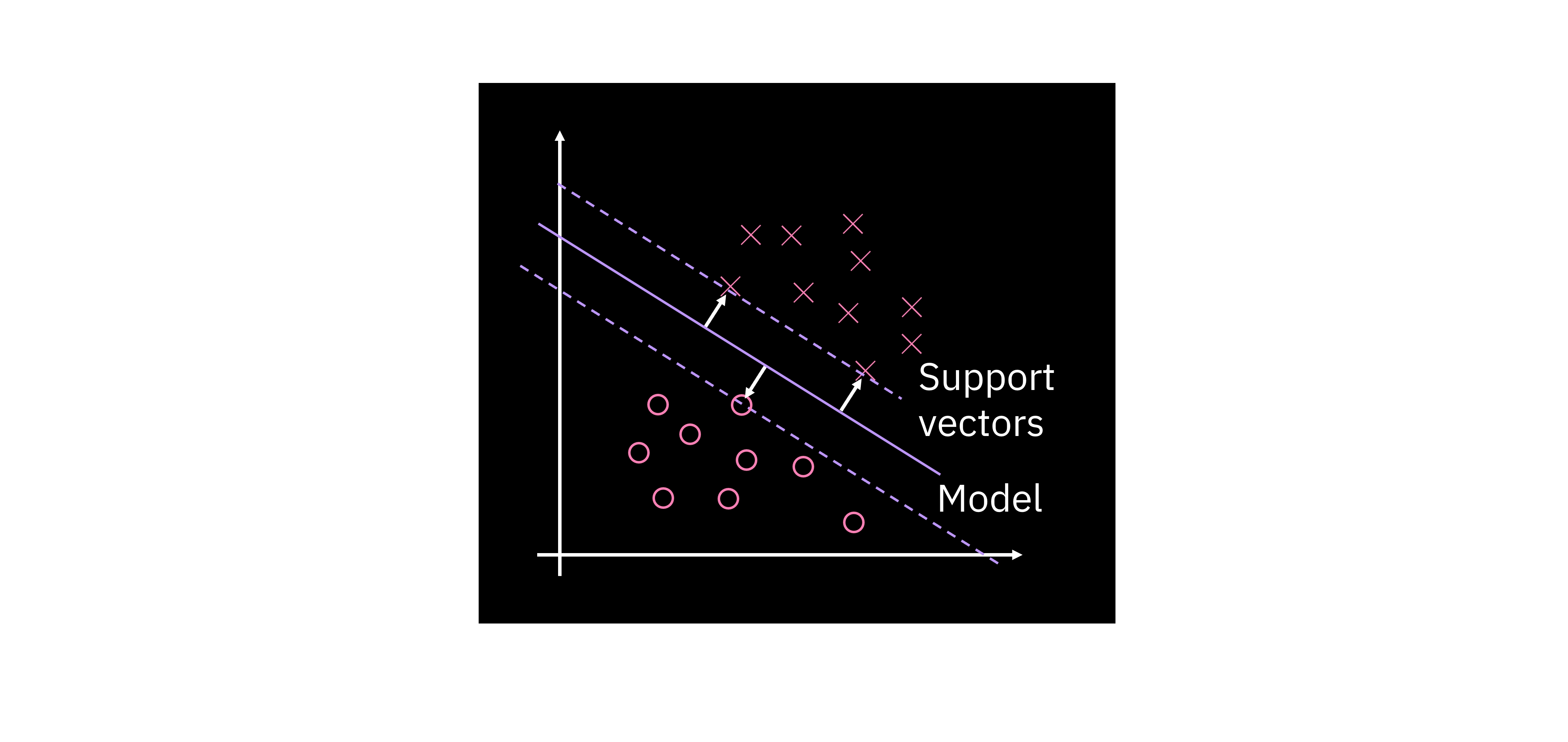

لنفترض مهمة تصنيف ثنائي على مجموعة بيانات ذات فضاء ميزات ثنائي الأبعاد كما هو موضح في الرسم. أحد الأشياء التي يمكننا فعلها لأداء التصنيف لهذه المجموعة هو إيجاد خط، أو بشكل عام مستوٍ فائق يفصل الفئتين. في الواقع يمكننا إيجاد عدد لانهائي من المستويات الفائقة الفاصلة، لذا السؤال هو: كيف نُعرِّف المثالي منها؟ الفكرة هنا أن حد القرار الجيد بشكل خاص ينبغي أن يُعظِّم الهامش، المُعرَّف بالمسافة إلى أقرب النقاط في كل فئة. في هذا الإطار، نقاط البيانات ذات أصغر مسافة إلى حد القرار تُسمى متجهات الدعم.

يمكن وصف حد القرار الخطي بعدة طرق؛ من أوضحها الطريقة الموضحة في أدناه. هنا، هي مجموعة المعاملات المُعرِّفة للمستوى الفائق، هي مجموعة بياناتك، و إزاحة ثابتة. هي تعيين من فضاء نقاط البيانات المدخلة في الغالب (لكن ليس بالضرورة) إلى فضاء أعلى أبعادًا. سنعود إلى هذا التعيين أدناه.

في النموذج ، هو متجه المعاملات القابلة للضبط التي سيتعلمها النموذج. هذا ما نسميه "الصياغة الأولية". ببعض التلاعب الرياضي يمكننا إظهار وجود طريقة ثانية لصياغة المشكلة ذاتها. نسمي هذه "الصياغة الثنائية"، موضحةً بالمعادلة أدناه. لهذه الصياغة نحتاج إلى التحسين على معاملات ألفا. الفارق الرئيسي هو أن الصياغة الأولية تحتوي على حاصل ضرب داخلي بين متجه الميزة والمعاملات القابلة للتعلم، بينما في الصياغة الثنائية الحاصل الضرب الداخلي هو بين متجهات الميزات. رغم أن الصورة الثنائية تتضمن كلًّا من ميزات بيانات التدريب والتسميات المقابلة لها، سنرى في القسم التالي كيف تثبت أنها أكثر فائدة من الصورة الأولية.

أساليب النواة وكيف يمكن للكم أن يؤدي دورًا

الفيديو التالي يُبيّن كيف يمكن للكم أن يؤدي دورًا في المصنّفات الخطية. يُشرح ذلك بمزيد من التفصيل في النص.

الانتقال إلى فضاءات أعلى أبعادًا

في هذا القسم والقسم التالي، يتمحور النقاش حول التعيينات إلى أبعاد أعلى. الهدف هنا شرح "خدعة النواة" في سياق التعيينات بين الفضاءات، وبالتالي تمهيد الأرضية لما هي النواة الكمومية. النقطة ليست أن الأبعاد الأعلى في الدوال الموجية الكمومية تحل جميع مشاكلنا. كما ذُكر في المقدمة، خرائط ميزات غاوس الكلاسيكية لا نهائية الأبعا�د بالفعل. أبعاد ميزات البيانات مهمة، لكن الحالات الكمومية عالية الأبعاد ليست كافية وحدها للتحسين على الأساليب الكلاسيكية.

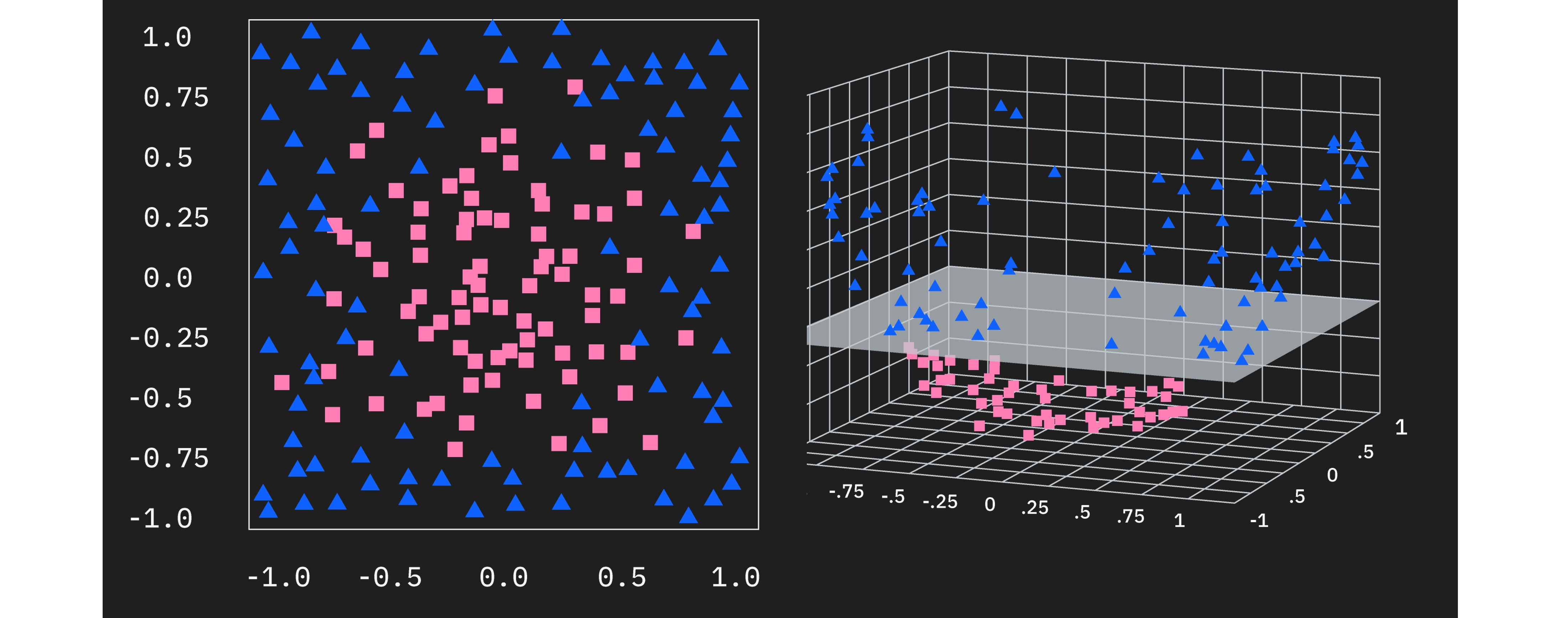

بيانيًا، يمكن للمرء رؤية كيف يمكننا تعميم نهج آلة المتجهات الداعمة للحالات التي لا تكون فيها البيانات الأصلية قابلة للفصل خطيًا، نظرًا للتعيين الصحيح إلى أبعاد أعلى. النظر في البيانات ثنائية الأبعاد على اليسار، نرى أنه لا يوجد حد قرار خطي يمكنه فصل الفئتين. غير أننا يمكننا النظر في إضافة ميزة ثالثة إلى فضاء ميزاتنا. إذا كانت هذه الميزة الجديدة — على سبيل المثال — المسافة إلى أصل الميزتَين السابقتَين و، فتصبح البيانات قابلة للفصل خطيًا. هذا يعني أيضًا أننا نستطيع الآن تشغيل خوارزمية آلة المتجهات الداعمة بنجاح على فضاء الميزات الأعلى أبعادًا.

نرمز أيضًا لـ"تعيين الميزات" هذا بـ . يُعيِّن تعيين الميزات في الغالب من فضاء البيانات المدخلة إلى بُعد أعلى كما هو موضح هنا، لكن ثمة نماذج وخوارزميات تستخدم التعيينات إلى أبعاد أدنى. التعيين إلى أبعاد أعلى هو ببساطة حالة سهلة للتصوير والفهم.

بعض تعيينات الميزات قد تُعيِّن إلى فضاءات عالية الأبعاد جدًا. في مثل هذه الحالات، الأبعاد العالية تجعل حواصل الضرب الداخلية أكثر تكلفةً حسابيًا. سنعود إلى تلك النقطة أدناه.

لماذا الصياغة الثنائية مفيدة؟

استذكر الصياغتَين الأولية والثنائية لنموذج الحد الخطي:

بعد أن عرفنا أن استخدام تعيين الميزات للوصول إلى فضاء أعلى أبعادًا يمكننا من إيجاد مستوٍ فائق فاصل بنجاح، يمكننا استبدال متجه الميزات الأصلي في المعادلات بالمتجهات المُعيَّنة بتعيين الميزات. غير أنه إذا فعلنا ذلك في الصياغة الأولية، نواجه مشكلة الاضطرار إلى حساب حواصل الضرب الداخلية بين المعاملات وتعيين ميزات عالي الأبعاد محتمل. أما في الصياغة الثنائية، نرى أن هذه تستبدل بحواصل ضرب داخلية بين متجهات مُعيَّنة لمدخلات مختلفة.

لبعض تعيينات الميزات، قد يكون ممكنًا كتابة حاصل الضرب الداخلي لمتجهات مُعيَّنة كدالة بسيطة للمتغيرات الأصلية (الأدنى أبعادًا) و. لبعض خيارات ، قد نتمكن حتى من كتابة كدالة بسيطة لحاصل الضرب الداخلي الأدنى أبعادًا . هذا مفيد حسابيًا جدًا لأننا نستطيع الوصول إلى الفضاء الذي تكون فيه البيانات قابلة للفصل خطيًا دون تكلفة العمليات في الأبعاد الأعلى. في الحقيقة، بما أن متجهات الميزات المُعيَّنة لا تظهر في إلا في حواصل ضرب داخلية، قد لا نحتاج حتى إلى تنفيذ تعيين الميزات صراحةً لحساب حواصل الضرب الداخلية. نسمي الدالة التي تحسب حواصل الضرب الداخلية "دالة النواة"، وت�ُسمى طريقة تجنّب حساب تعيين الميزات هذه "خدعة النواة". في الحقيقة، يمكن أن تكون متجهات الميزات المُعيَّنة لا نهائية الأبعاد، لكن النواة قد لا تزال قابلة للحساب بكفاءة عالية.

دالة النواة ذاتها دالة لمتجهَي بيانات مدخلَين. إدراج كل زوج من متجهات البيانات في مجموعة البيانات كوسيطات لدالة النواة يُنتج مصفوفة متماثلة شبه موجبة القطعية، تُسمى مصفوفة النواة:

بعد حساب مصفوفة النواة، يمكننا إيجاد المعاملات المثالية () باستخدام أساليب مثل برامج البرمجة التربيعية أو خوارزمية تُسمى "التحسين الأدنى التسلسلي". بالطبع، هذا يفترض وجود نواة قابلة للحساب بكفاءة تتوافق مع تعيين ميزات يجعل فئات بياناتك قابلة للفصل خطيًا. نهج ذو صلة لكنه جديد هو تقدير النواة الكمومية.

النوى الكمومية

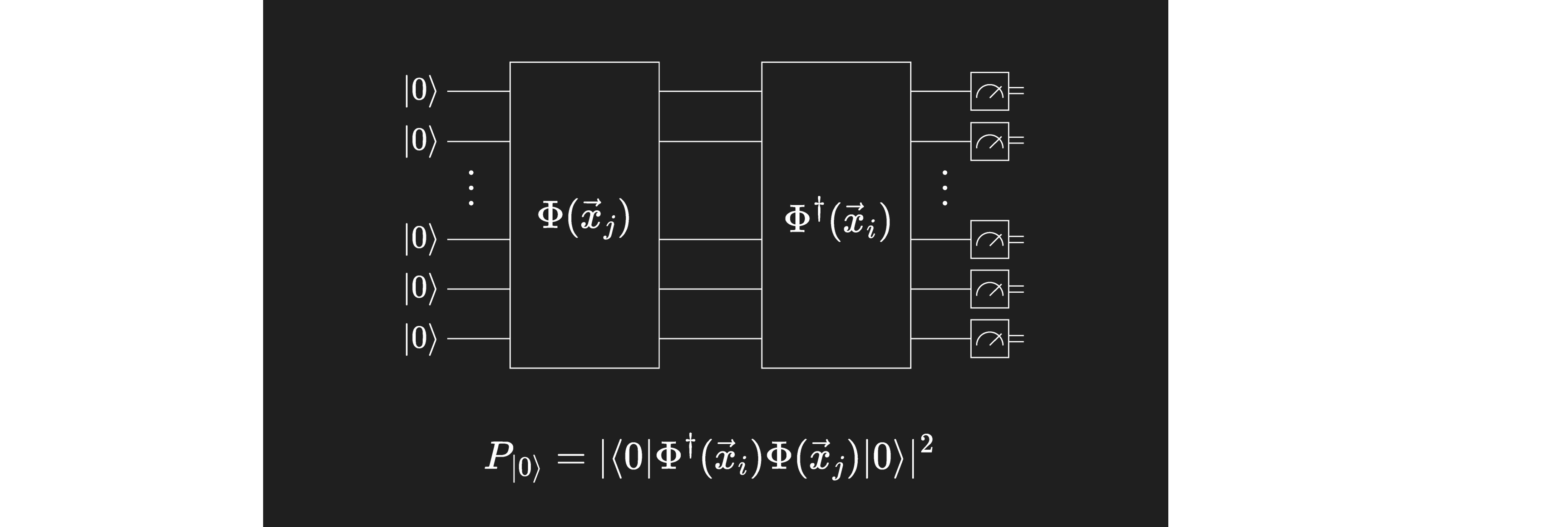

تتيح الحواسيب الكمومية، أو الحالات الكمومية عمومًا، تعريفًا طبيعيًا جدًا لـ"النواة الكمومية". يمكننا تفسير ترميز مدخل في حالة كمومية كتعيين ميزات. قد يُعيِّن هذا الفرايند البيانات فعليًا إلى فضاء عالي الأبعاد جدًا كما هو شائع في تعيينات الميزات الكلاسيكية، لكن الأبعاد ستعتمد على طريقة الترميز (راجع درس ترميز البيانات). تذكّر أن حاصل الضرب الداخلي لحالتَين كموميتَين مرتبط باحتمال قياس الحالة حين نكون في الحالة . يمكننا تقدير حاصل الضرب الداخلي لنقطتَي البيانات المُعيَّنتَين و بإجراء قياسات كافية للدائرة الناتجة.

كما سنرى لاحقًا في الدورة، يمكننا استخدام القياسات على دائرة كمومية كالموضحة أعلاه لتقدير نواة، ثم تشغيل تحسين آلة المتجهات الداعمة كلاسيكيًا على مصفوفة النواة لتعلم المعاملات القابلة للضبط.

الدوائر الكمومية المتغيرة والشبكات العصبية

خوارزمية تعلم آلة كمومية أخرى قريبة المدى تُسمى "الدوائر الكمومية المتغيرة" (VQCs). حين تُستخدم هذه الدوائر في مهمة تصنيف، قد ترى الاختصار ذاته مستخدمًا للإشارة إلى "المصنّفات الكمومية المتغيرة" (أيضًا VQCs). كثيرًا ما تستغل هياكل مشابهة للشبكات العصبية الكلاسيكية (NNs)؛ وفي تلك الحالات ستراها تُوصف بالشبكات العصبية الكمومية (QNNs). من المهم فهم أن VQCs أكثر عمومية ولا تحتاج إلى اتباع هيكل الشبكة العصبية، لكننا نبدأ بالتشبيه مع الشبكات العصبية لمساعدة في توضيح الدور الذي يمكن للكم أداؤه في سير العمل لتعلم الآلة الحالي. ثم سنناقش التعميمات. نبدأ بمراجعة الشبكات العصبية الكلاسيكية.

الفيديو التالي يُقدّم مراجعة موجزة للشبكات العصبية وأوجه تداخلها مع الدوائر الكمومية المتغيرة. يُستكشف ذلك بمزيد من التفصيل في النص.

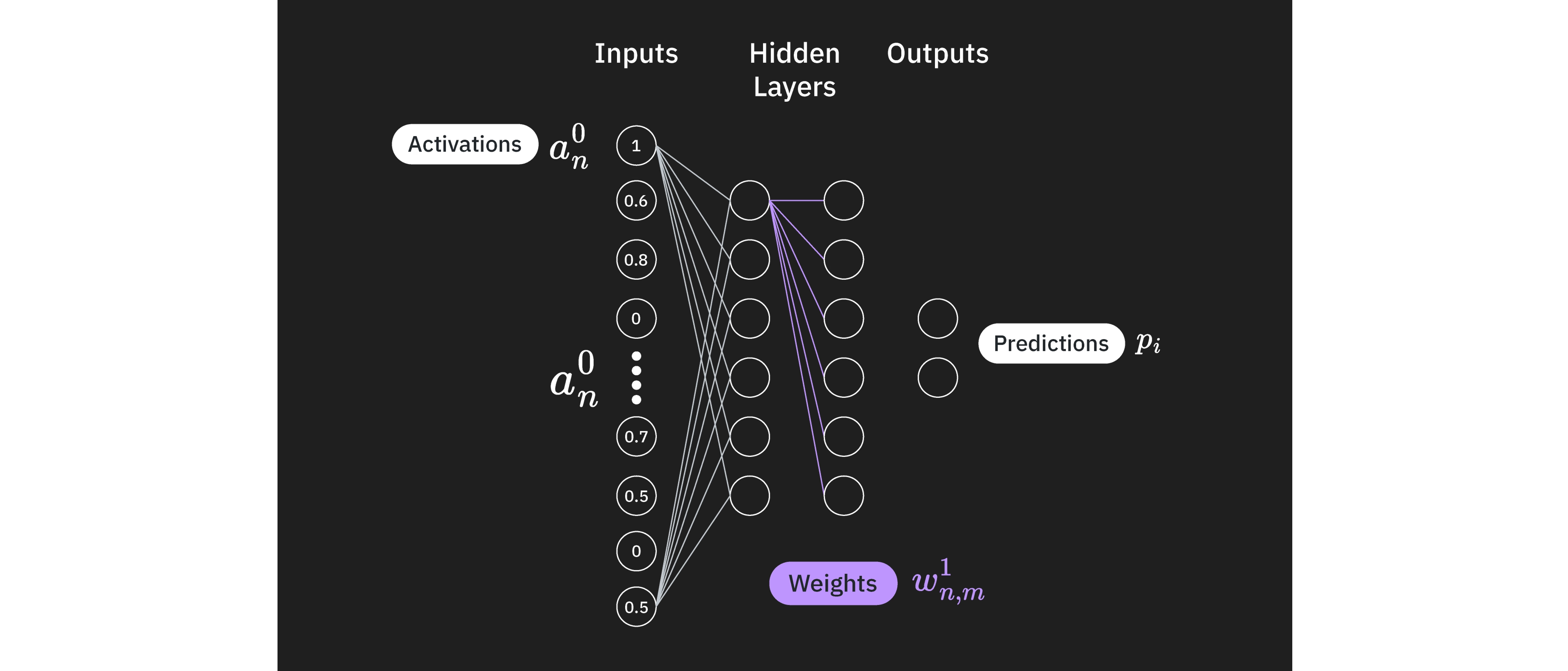

الشبكة العصبية هي نموذج حسابي مستوحى بشكل فضفاض من بنية ووظيفة الخلايا العصبية في الدماغ. هذه الخلايا العصبية، وهي العقد التي نراها في الصورة، مُنظَّمة في طبقات ومترابطة من خلال أوزان.

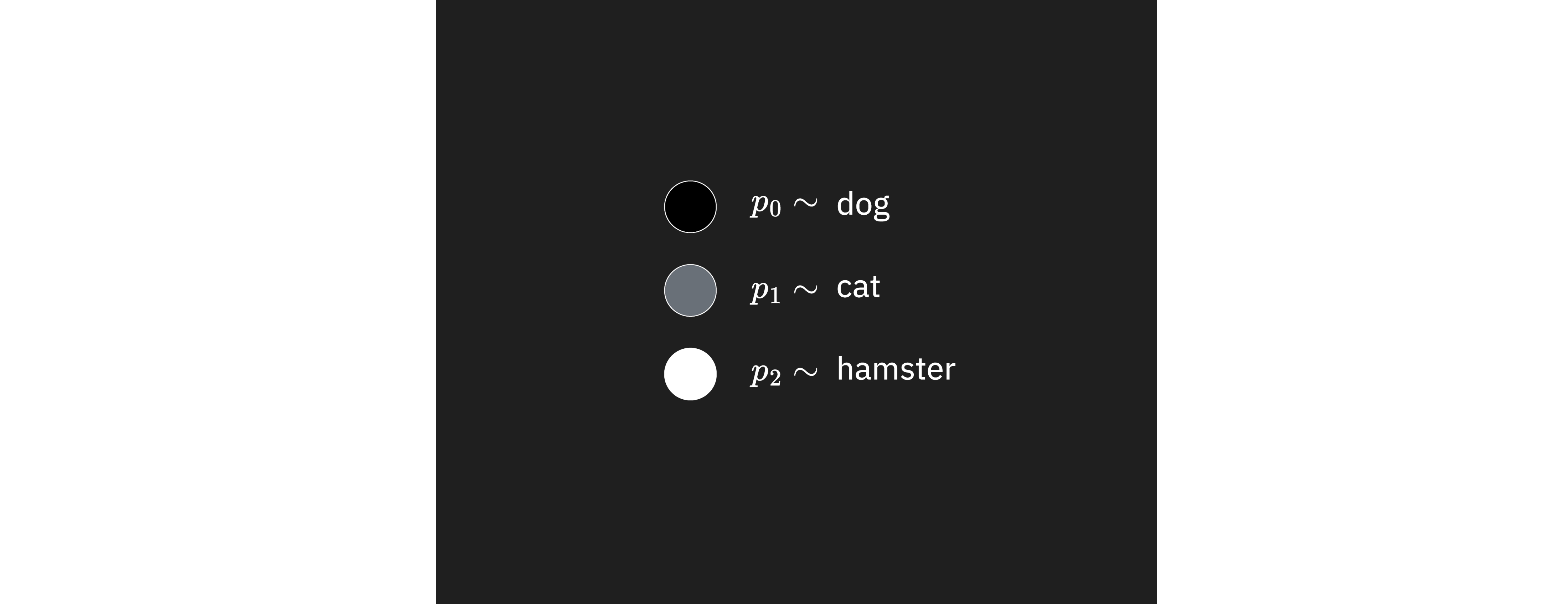

الطبقة الأولى هي طبقة المدخلات، وتُغذَّى تنشيطات الخلايا العصبية في هذه الطبقة مباشرةً من البيانات المراد تحليلها (كظلال البكسلات الفردية في صورة مثلًا). الطبقة الأخيرة هي طبقة مخرجات تصف التصنيف (كتصنيف صورة بنسبة احتمالية 90% لأنها كلب و10% لأنها قطة، للتمسك بمثال الصورة).

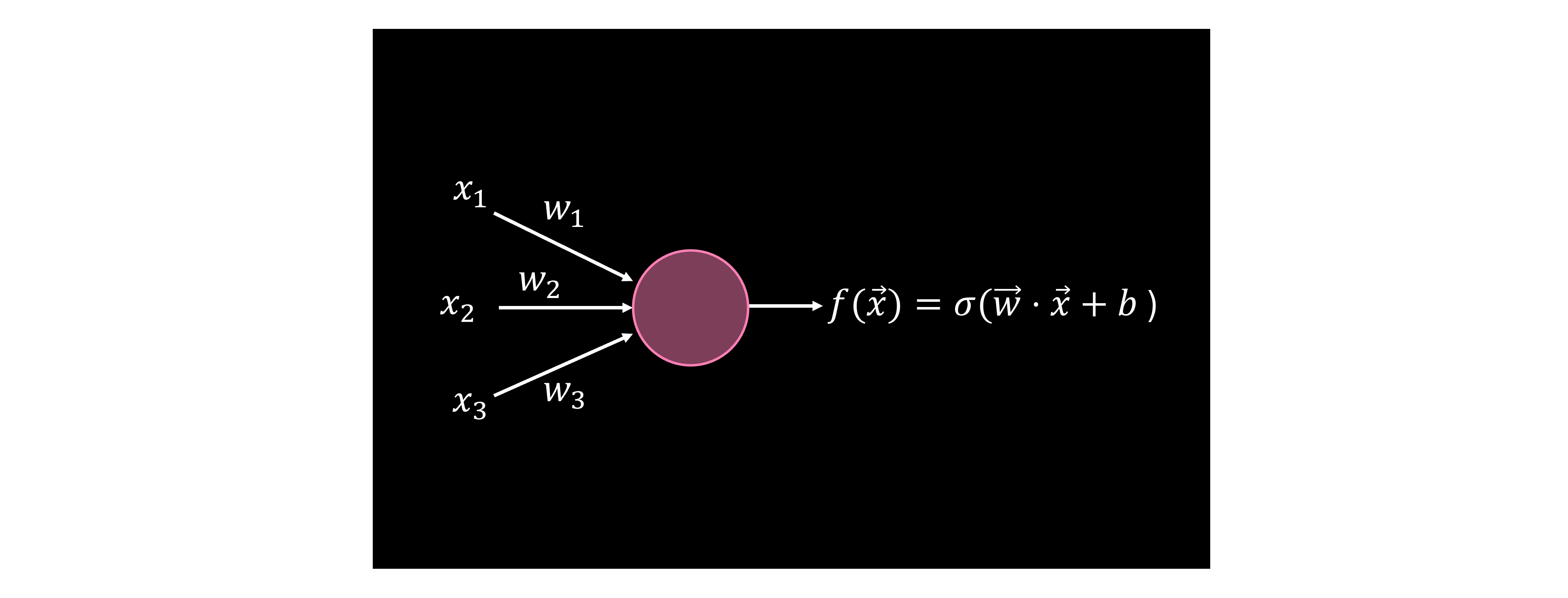

تعالج الخلايا العصبية في كل طبقة الإشارات التي تتلقاها من الطبقة السابقة وتنقلها إلى التالية عبر أوزان، (الاتصالات في المخطط). إذا ركّزنا على إحدى هذه الخلايا العصبية، لدينا الوحدة الأساسية للشبكة العصبية، التي تُسمى "البيرسبترون". رياضيًا، يأخذ البيرسبترون متجه مدخل ، ويحسب حاصل ضربه الداخلي مع متجه وزن قابل للتدريب بالإضافة إلى تحيّز. والأهم جدًا، يُطبّق البيرسبترون دالة تنشيط غير خطية () فوق هذه الحسابات. دوال التنشيط غير الخطية هذه حيوية للقدرة التعبيرية الهائلة للشب�كات العصبية. طريقة أخرى للتفكير في ذلك هي أننا لو لم تكن لدينا لاخطية بين الطبقات، يمكننا من حيث المبدأ كتابة الشبكة العصبية بأكملها كضرب مصفوفة واحد كبير. هذا سيُنتج ببساطة نموذجًا خطيًا، لن يكون قادرًا على التقاط الأنماط المعقدة التي تستطيع الشبكات العصبية العميقة التقاطها. لذا دوال التنشيط غير الخطية أساسية في الشبكات العصبية.

دوال مثل

تُحسب في كل خلية عصبية باستخدام البيانات المعروفة والدالة غير الخطية وأيضًا متجهات الأوزان والتحيزات المجهولة. بشكل عام، قد توجد أوزان غير صفرية بين جميع خلايا عصبية لج�ميع الطبقات، وسنسمي الأوزان من الطبقة إلى الطبقة بين الخلايا العصبية و، . وبالمثل، التحيز على الخلية العصبية في الطبقة سيكون . التحيزات هنا لا علاقة لها بـ من نقاش النواة الكمومية.

قد تبدأ شبكتك العصبية بمجموعة عشوائية من الأوزان والتحيزات، أو من تهيئة معقولة ومعروفة. من هناك، الفكرة هي التحقق من مدى جودة تصنيف شبكتك العصبية وتحسينها. نستخدم دالة تكلفة لوصف مدى انحراف شبكتنا العصبية عن التصنيف الصحيح. هناك طرق عديدة لتعريف دالة التكلفة. سنصف مثالًا شائعًا هنا يتضمن متوسط الخطأ التربيعي (MSE):

وفق تطبيقك، قد يعني ذلك أخذ الفارق بين القيمة الفعلية لصورة من بيانات التدريب للمخرج (مثلًا، قيمة 1.0 على خلية طبقة المخرج العصبية لـ"كلب" وقيمة 0 على جميع الخلايا الأخرى) والقيمة المتنبأ بها . نُربِّع هذا الفارق ونجمع على جميع الفئات، بحي�ث لا يلتقط فقط هل الفئة الصحيحة هي الأكثر تنشيطًا، بل أيضًا هل تنخفض التنشيطات غير الصحيحة. ثم نجمع على جميع الأمثلة في مجموعة التدريب لنحصل على تكلفة.

ثم نُغيِّر المعاملات كالأوزان في كل طبقة بين جميع الخلايا العصبية والتحيزات على جميع الخلايا. تُستخدم روتينات التحسين الكلاسيكية مثل الانحدار التدريجي للبحث عن حد أدنى محلي في دالة التكلفة.

البيرسبترون الكمومي

لنتمكن من بناء النظير الكمومي للبيرسبترون، أحد الأشياء التي نحتاج إلى أخذها بعين الاعتبار هو القدرة على تطبيق اللاخطية مع الدوائر الكمومية، وهو دور دالة التنشيط في الشبكات العصبية الكلاسيكية. هذا لأنه بدون اعتبارات إضافية، تُطبّق الدوائر الكمومية عمليات أحادية فحسب، والتي هي ببساطة خطية. توجد طرق مختلفة يمكننا استخدامها لإدخال اللاخطية في الدوائر الكمومية. من الطرق الرئيسية هو استخدام القياسات كمصدر للاخطية. اعتبارات أخرى تشمل أساليب قائمة على تحويل فورييه الكمومي، والقياسات الداخلية للدائرة أو الدوائر الديناميكية، وتتبّع الكيوبتات خارج الدائرة.

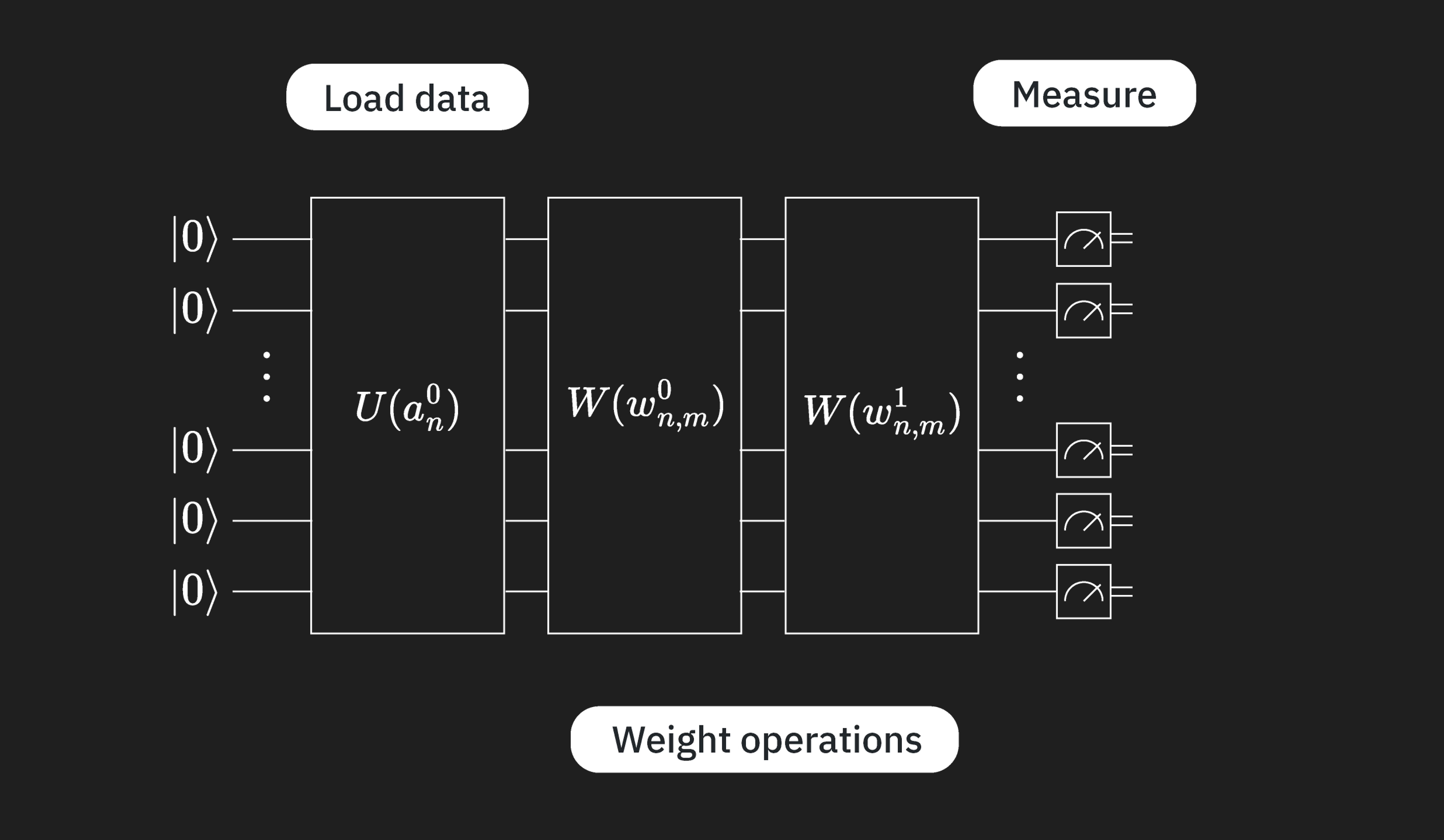

الشبكة العصبية الكمومية

تعمل الشبكة العصبية الكمومية (QNN) أولًا بترميز البيانات المدخلة مع الطبقة الأحادية في الشكل، ثم تطبيق دوائر كمومية تتوافق مع الأوزان بين الطبقات ( أدناه)، وأخيرًا طبقة من القياس. بعض النقاط المهمة حول ذلك:

- تحميل البيانات والأوزان هي عمليات خطية.

- القياسات غير خطية.

- وبالتالي كما في الشبكة العصبية الكلاسيكية، لدينا مكوّنات خطية وغير خطية معًا.

- دوائر الأوزان لا تزال تمتلك معاملات متغيرة، لذا لا يزال ثمة تصغير كلاسيكي ينبغي إجراؤه.

يمكننا استخدام دائرة كالموضحة أعلاه لحساب دالة لاحظ أن هذه الدالة ليست بشكل عام مطابقة للدالة الموصوفة في الشبكات العصبية الكلاسيكية. تحديدًا، تتضمن هذه الدالة طبقات عديدة محتملة من أوزان كثيرة، وتُطبَّق على جميع البيانات المُحمَّلة في دائرتك الكمومية بواسطة .

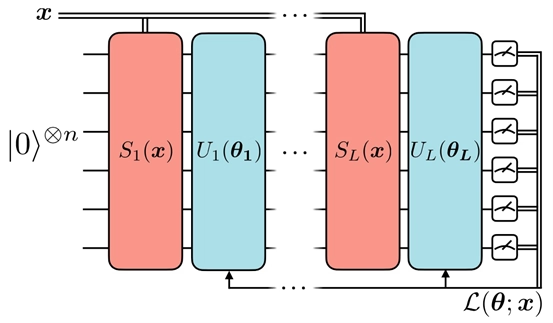

التعميمات

يمكننا الآن النظر في إحدى طرق بناء النظير الكمومي للشبكة العصبية. في هذا النموذج، تدفق المعلومات مختلف عن الشبكة العصبية الكلاسيكية الأمامية التغذية. في الإطار الكلاسيكي، تتدفق المعلومات من اليسار إلى اليمين، بدءًا بالمدخل وانتهاءً بمخرج النموذج، وفي الاتجاه المعاكس عند الانتشار الخلفي لتدريب النموذج.

غير أن في بناء الشبكة العصبية الكمومية هذا، نرى أن الكتلة الأحادية التي تُرمِّز البيانات تكرر ذاتها بين الكتل الأحادية المتغيرة ذات المعاملات القابلة للتدريب. هذه الاستراتيجية، التي نشير إليها بـ"إعادة رفع البيانات (data reuploading)"، مدعومة بنتائج نظرية رائعة. في الحقيقة، ورقة بحثية لـPérez-Salinas et al. تُظهر أنه مع مساعدة إعادة رفع البيانات المتعددة، "يوفر كيوبت واحد قدرات حسابية كافية لبناء مصنِّف كمومي شامل عند مساعدته بروتين كلاسيكي فرعي." وبالتالي، إعادة رفع البيانات هي تقنية يمكننا استخدامها لتعزيز التعبيرية والقدرة التمثيلية للنموذج، مما يسمح للشبكة العصبية الكمومية بتقريب الدوال المعقدة.

المراجع

[1] "Reinforcement Learning: An Introduction", Richard S. Sutton and Richard G. Barto, MIT Press, Second Edition, Cambridge, MA, 2018

[2] "Pattern Recognition and Machine Learning", Christopher M. Bishop, Springer, 2006

[3] "Foundations of Machine Learning", Mehryar Mohri, Afshin Rostamizadeh, and Ameet Talwalkar, MIT Press, Second Edition, 2018.